TV Box MXQ Atualização

Você já deve ter ouvido falar dos receptores de satélite TV Box, não é mesmo? Se você ainda não o conhece, já passou da hora de conhecer.

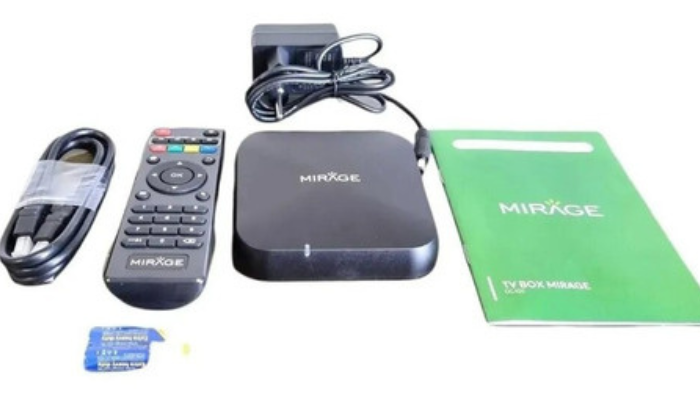

Os aparelhos receptores da TV Box nada mais são do que aparelhos que acessam, através dos sinais de satélite, canais ilimitados para os usuários. Livrando-os das taxas de mensalidade exorbitantes que as companhias costumam aplicar.

E o melhor de tudo, os produtos da TV Box são homologados pela Anatel, ou seja, são legalizados e disponibilizados para você, e todo o brasileiro.

Bom, a TV Box possui diversos aparelhos receptores, no entanto, o aparelho mais conhecido da marca, devido a sua praticidade e utilidade é o aparelho TV Box MXQ.

E é sobre este aparelho que falaremos aqui ao longo deste texto. Caso você não conheça ainda os produtos da TV Box, mas tem interesse, este texto é para você. Não perca nenhuma informação abaixo.

O que é o aparelho TV BOX MXQ?

Pois bem, o aparelho da TV Box MXQ nada mais é do que um modelo de receptores da TV Box. Ele é o modelo que mais se destaca devido a sua funcionalidade, ferramentas e utilidade. Bom, é claro que, por ter ficado conhecido, não é à toa.

Portanto, é seguro dizer que o aparelho TV Box MXQ é um dos melhores aparelhos da empresa e um dos melhores do mercado, atualmente. Isso porque, o aparelho TV Box MXQ possui inúmeros dispositivos tecnológicos que servem apenas para o bom uso do usuário.

Dentre os dispositivos tecnológicos do aparelho, podemos verificar: um sistema de Android recente e que recebe constante atualização. Rede de sinal para internet e Bluetooth, permitindo que o usuário possa acessar sites.

Rede de aplicativos, para que o usuário acesse os aplicativos dos serviços de streaming, e muito mais. Bom, além disso, o aparelho possui uma memória interna capaz de realizar downloads de qualquer aplicativo que queira, e você pode ver tudo isso, na tela da sua televisão.

Pode parecer estranho, no entanto, o aparelho TV Box MXQ funciona da seguinte forma: Uma vez acoplada a sua televisão através de um cabo HDMI, o receptor acessa os canais via satélite, disponibilizando todos na sua televisão.

Além disso, nas configurações, você pode acessar todos os serviços citados acima, tendo acesso, portanto, ao Youtube, Netflix, Globoplay, HBO Max, Disney + e muito mais.

Você pode até acessar jogos online através do seu aparelho TV Box MXQ. Incrível não é mesmo? E tudo isso sem realizar um pagamento mensal exorbitante que as companhias têm cobrado.

É necessário lembrar, no entanto, que assim como todo o aparelho que possui um sistema operacional de software, no caso deste, o Android, as atualizações são importantes e necessárias. Veja a seguir como funciona para realizar a atualização 2024 no seu aparelho TV Box MXQ.

Como funciona a atualização do aparelho TV Box MXQ?

Bom, o aparelho TV Box MXQ é um dos melhores aparelhos do mercado exatamente devido a seu sistema operacional Android.

Isso porque, este sistema é atual e atende o usuário sempre de forma mais rápida e eficiente, tanto em seu processamento interno, quanto para acessar os serviços de streaming mais rapidamente.

Dessa forma, para manter o seu aparelho com um bom e pleno funcionamento, é necessário realizar atualizações. Lembre-se que, da mesma forma que o seu telefone celular é atualizado, o aparelho também precisa ser. Isso para evitar que o aparelho fique obsoleto.

Pois bem, para realizar a atualização 2024 do seu aparelho TV Box MXQ é bem simples.

O primeiro passo é abrir na página inicial do aparelho, uma vez conectado com a sua televisão.

Na página inicial do aparelho, vá até a opção “Configurações”, e selecione a opção “dispositivo”.

Após isso, basta selecionar a opção “suporte” e “status e diagnostico”. Por fim, clique na opção “atualização do software do sistema”.

Uma vez que você selecionar a atualização do software, o próprio aparelho realizará a atualização de forma automática e, portanto, após a atualização, você poderá utilizá-lo sem nenhuma dificuldade.

Essa atualização 2024 serve para manter o seu aparelho com as melhores qualidades de áudio e vídeo, além de um processamento rápido para você assistir seus filmes e séries favoritos.

Portanto, lembre-se de sempre verificar se há uma atualização pendente no seu aparelho, pois, caso haja, isso pode estar mantendo o seu aparelho lento e sem respostas.

Além disso, lembre-se, ainda, de mantê-lo conectado a uma rede de internet. Isso porque, caso a internet esteja falhando, os acessos de streaming não irão funcionar, uma vez que são movidos a base da rede de Wi Fi.

Dessa forma, verificando se todos os dispositivos estão em pleno funcionamento, você poderá aproveitar do seu receptor sem nenhum problema de conexão ou lentidão. Não perca tempo, e adquira já o seu receptor TV Box MXQ, e faça a atualização 2024 necessária.